2025年のGTCで、黄仁勋はNVIDIAがNokiaに10億ドルを投資するという衝撃的なニュースを発表しました。そう、20年前にSymbian携帯電話で一世を風靡したあのNokiaです。

黄仁勋は講演で、通信ネットワークが従来のアーキテクチャからAIネイティブシステムへの大きな転換期にあり、NVIDIAの投資がこのプロセスを加速させると述べました。NVIDIAは投資という形でNokiaと共同で6Gネットワーク向けのAIプラットフォームを構築し、AIを従来のRANネットワークに組み込むことになります。

具体的な投資形態は、NVIDIAが1株あたり6.01ドルでNokiaの新株約1億6600万株を引き受け、NVIDIAはNokiaの約2.9%の株式を保有することになります。

協力発表の瞬間、Nokiaの株価は21%上昇し、2013年以来最大の上昇幅となりました。

01 AI-RANとは何か?

RANは無線アクセスネットワークのことで、AI-RANはAIの計算能力を無線基地局に直接組み込む新しいネットワークアーキテクチャです。従来のRANシステムは主に基地局とモバイルデバイス間のデータ伝送を担当していましたが、AI-RANはこれにエッジコンピューティングとインテリジェント処理機能を追加します。

基地局がAIアルゴリズムを活用してスペクトル利用率やエネルギー効率を最適化し、ネットワーク全体のパフォーマンスを向上させると同時に、余剰のRAN資産を活用してエッジAIサービスをホスティングし、オペレーターに新たな収益源をもたらします。

オペレーターは基地局現場で直接AIアプリケーションを実行でき、すべてのデータを中央データセンターに戻して処理する必要がなくなり、ネットワークの負担が大幅に軽減されます。

黄仁勋は例を挙げ、ほぼ50%のChatGPTユーザーがモバイルデバイスを通じてアクセスしており、さらにChatGPTの月間モバイルダウンロード数は4000万を超えています。AIアプリケーションが爆発的に増加する時代に、従来のRANシステムでは生成AIやエージェント主導のモバイルネットワークに対応できません。

AI-RANはエッジで分散型AI推論能力を提供することで、今後のAIアプリケーション、たとえばエージェントやチャットボットの応答速度を向上させます。同時に、AI-RANは6G時代の統合センシングおよび通信アプリケーションにも備えています。

黄仁勋はアナリスト企業Omdiaの予測を引用し、同社はRAN市場が2030年までに累計2000億ドルを超え、その中でもAI-RAN分野が最も成長の速いセグメントになると予測しています。

Nokiaの社長兼CEOであるPekka Lundmarkは共同声明で、このパートナーシップによりAIデータセンターが誰のポケットにも入り、5Gから6Gへの根本的な再設計が実現すると述べました。

彼は特に、NokiaがNVIDIA、Dell、T-Mobileという異なるタイプの企業と協力していることに言及しました。T-Mobileは最初のパートナーの一つとして、2026年からAI-RAN技術の現場テストを開始し、パフォーマンスと効率の向上を重点的に検証します。Pekkaは、このテストが6Gイノベーションに貴重なデータを提供し、オペレーターがAI需要に適応したインテリジェントネットワークを構築するのに役立つと述べました。

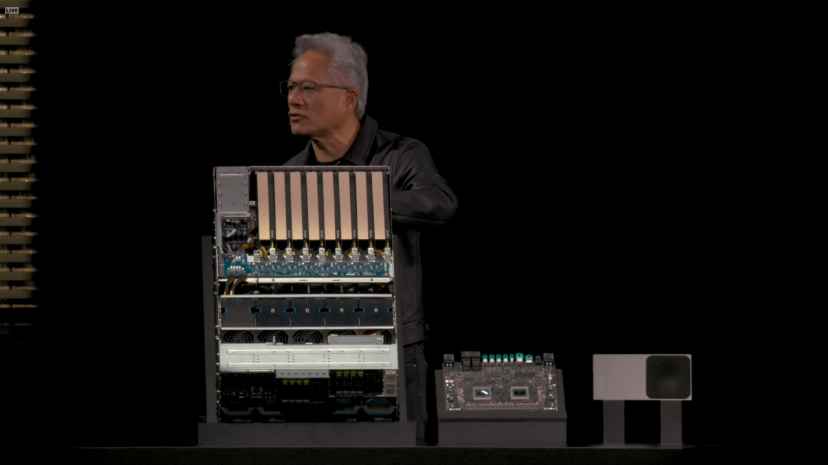

AI-RANを基盤に、NVIDIAが発表した新製品はAerial RAN Computer Pro(ARC-Pro)で、これは6Gに備えたアクセラレーテッドコンピューティングプラットフォームです。コアハードウェア構成にはNVIDIAの2種類のGPU、Grace CPUとBlackwell GPUが含まれています。

このプラットフォームはNVIDIA CUDAで動作し、RANソフトウェアはCUDAテクノロジースタックに直接組み込むことができます。したがって、従来の無線アクセスネットワーク機能を処理できるだけでなく、主流のAIアプリケーションも同時に実行できます。これがNVIDIAがAI-RANにおける「AI」の2文字を実現するコア手法です。

CUDAの長い歴史を考えると、このプラットフォームの最大の利点はプログラマビリティです。さらに、黄仁勋はAerialソフトウェアフレームワークをオープンソース化し、2025年12月からGitHubでApache 2.0ライセンスのもと公開する予定であると発表しました。

ARC-Proとその前世代製品ARCの主な違いは、展開場所と利用シーンにあります。前世代のARCは主に集中型クラウドRANの実現に使われていましたが、ARC-Proは基地局現場に直接展開できるため、エッジコンピューティング能力が真に実現されます。

NVIDIAの通信事業責任者であるRonnie Vashistaは、従来はRANとAIを実現するために2つの異なるハードウェアが必要でしたが、ARC-Proはネットワークの需要に応じて計算リソースを動的に割り当てることができ、無線アクセス機能を優先的に処理することも、アイドル時にはAI推論タスクを実行することもできると述べました。

ARC-ProはさらにNVIDIA AI Aerialプラットフォームを統合しており、これはCUDA加速のRANソフトウェア、Aerial Omniverseデジタルツインツール、新しいAerial Frameworkを含む完全なソフトウェアスタックです。Aerial FrameworkはPythonコードを高性能なCUDAコードに変換し、ARC-Proプラットフォーム上で実行できます。また、プラットフォームはAI駆動のニューラルネットワークモデルもサポートし、高度なチャネル推定に使用されます。

黄仁勋は、通信は経済と安全のデジタル神経系であり、Nokiaや通信エコシステムとの協力がこの革命に火をつけ、オペレーターがインテリジェントで適応性のあるネットワークを構築し、次世代のグローバル接続を定義するのに役立つと述べました。

02 2025年を見据えて、NVIDIAは本当に多くの資金を投じています。

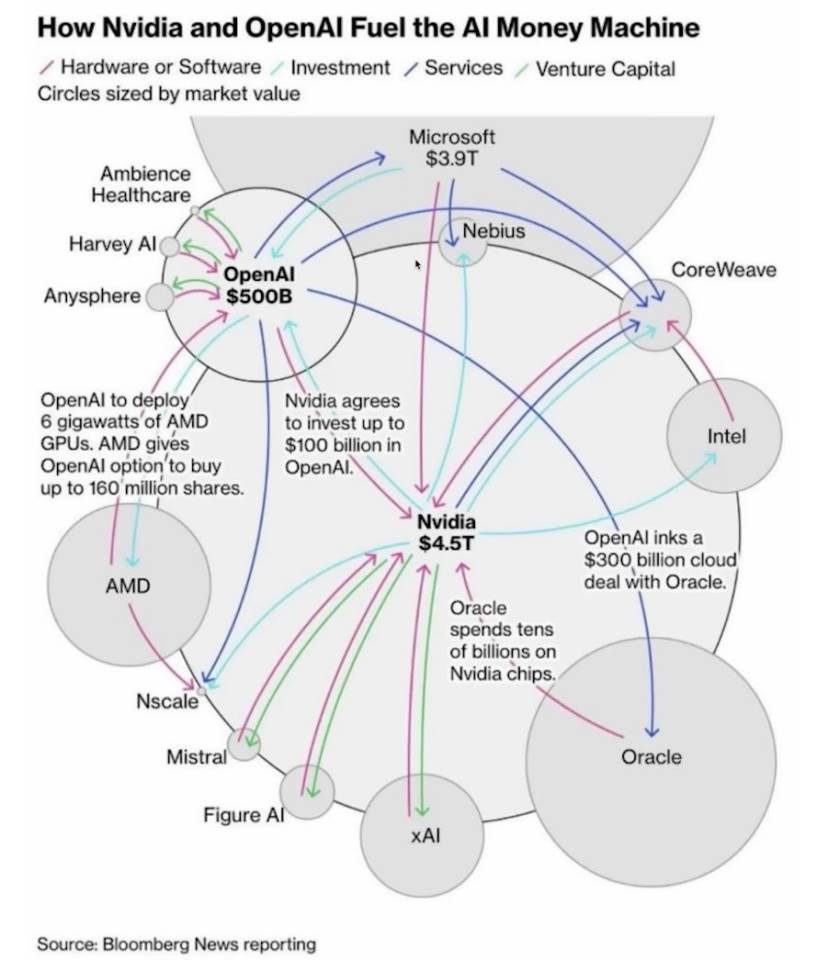

9月22日、NVIDIAはOpenAIと提携し、NVIDIAはOpenAIに段階的に1000億ドルを投資する計画を発表しました。これによりOpenAIのインフラ構築が加速されます。

黄仁勋は、実はOpenAIはかなり前からNVIDIAの投資を求めていたが、当時は会社の資金が限られていたと語りました。彼はユーモアを交えて、当時はとても貧乏で、実際には全てのお金を彼らに渡すべきだったと述べました。

黄仁勋は、AI推論の成長は100倍や1000倍ではなく、10億倍であると考えています。そしてこの協力はハードウェアにとどまらず、ソフトウェアの最適化も含まれ、OpenAIがNVIDIAのシステムを効率的に活用できるようにします。

これは、おそらくOpenAIがAMDと提携したことを知った後、OpenAIがCUDAを放棄することを懸念したためでしょう。もし世界最大のAI基盤大規模モデルがCUDAを使わなくなれば、他の大規模モデル企業もOpenAIに倣うのは当然のことです。

黄仁勋はBG2ポッドキャスト番組で、OpenAIが次の1兆ドル企業になる可能性が高く、その成長速度は業界記録を打ち立てるだろうと予測しました。彼はAIバブル論を否定し、世界のAIインフラへの年間資本支出が5兆ドルに達すると指摘しました。

まさにこの投資のおかげで、OpenAIは10月29日に会社の資本再編を完了したと発表しました。会社は2つの部分に分割され、一方は非営利財団、もう一方は営利企業となりました。

非営利の財団は法的に営利部門をコントロールし、公共の利益も考慮しなければなりません。しかし、引き続き資金調達や企業買収を自由に行うことができます。財団はこの営利企業の26%の株式を保有し、ワラントも持っています。会社がさらに成長すれば、財団は追加の株式も取得できます。

OpenAI以外にも、NVIDIAは2025年にElon MuskのxAIにも投資しました。この会社の現在の資金調達ラウンドは200億ドルに拡大され、そのうち約75億ドルが株式で、最大125億ドルが特別目的事業体(SPV)の債券で調達されます。

この特別目的事業体の運用方法は、調達した資金でNVIDIAの高性能プロセッサを購入し、それをxAIに貸し出すというものです。

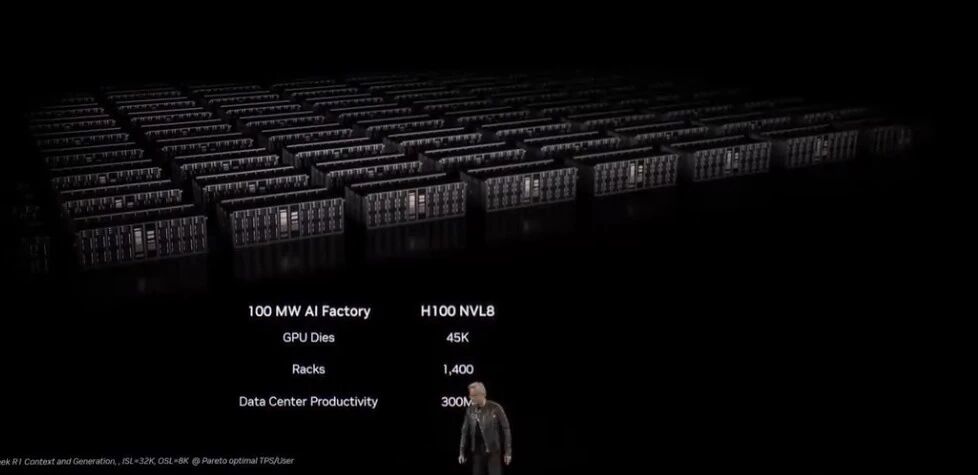

これらのプロセッサはxAIのColossus 2プロジェクトに使用されます。Colossus初代はxAIがテネシー州メンフィスに設置したスーパーコンピューティングデータセンターです。Colossus初代プロジェクトではNVIDIA H100 GPUを10万個配備し、世界最大級のAIトレーニングクラスターの一つとなっています。現在xAIが建設中のColossus 2は、GPUの数を数十万台、あるいはそれ以上に拡大する計画です。

9月18日、NVIDIAはIntelに50億ドルを投資し、深い戦略的パートナーシップを築くことも発表しました。NVIDIAは1株あたり23.28ドルでIntelの新発行普通株を引き受け、総投資額は50億ドルに達します。取引完了後、NVIDIAはIntelの約4%の株式を保有し、重要な戦略的投資家となります。

03 もちろん、このGTCで黄仁勋は他にも多くのことを語りました。

例えばNVIDIAは、デジタルAI向けのNemotron、物理AI向けのCosmos、ロボット向けのIsaac GR00T、生物医学AI向けのClaraなど、複数のオープンソースAIモデルファミリーを発表しました。

同時に、黄仁勋はDRIVE AGX Hyperion 10自動運転開発プラットフォームを発表しました。これはレベル4自動運転向けのプラットフォームで、NVIDIAの計算チップと完全なセンサーキット(LiDAR、カメラ、レーダーを含む)を統合しています。

NVIDIAはまた、Halos認証プログラムを発表しました。これは業界初の物理AI安全性評価・認証システムで、自動運転車やロボット技術を対象としています。

Halos認証プログラムのコアはHalos AIシステムで、これは業界初のANSI認証委員会に認められたラボです。ANSIは米国国家規格協会であり、その認証は非常に高い権威と信頼性を持っています。

このシステムの任務は、NVIDIAの物理AIを通じて自動運転システムが基準を満たしているかどうかを検証することです。AUMOVIO、Bosch、Nuro、Wayveなどの企業がHalos AIシステム検証ラボの最初のメンバーです。

レベル4自動運転を推進するため、NVIDIAは25カ国から収集したマルチモーダル自動運転データセットを発表しました。この中には1700時間分のカメラ、レーダー、LiDARデータが含まれています。

黄仁勋は、このデータセットの価値はその多様性と規模にあり、異なる道路状況、交通ルール、運転文化をカバーし、より汎用的な自動運転システムのトレーニング基盤を提供すると述べました。

しかし、黄仁勋のビジョンはこれだけにとどまりません。

彼はGTCで、米国政府の研究所やリーディングカンパニーとの一連の協力を発表し、米国のAIインフラ構築を目指すと述べました。黄仁勋は、私たちはAI産業革命の夜明けにあり、これはすべての産業と国家の未来を定義するだろうと語りました。

今回の協力の目玉は米国エネルギー省との協力です。NVIDIAはエネルギー省が2つのスーパーコンピューティングセンターを建設するのを支援しています。一つはArgonne National Laboratory、もう一つはLos Alamos National Laboratoryです。

Argonne LaboratoryはSolsticeというスーパーコンピュータを導入します。このシステムにはNVIDIA Blackwell GPUが10万個搭載されます。10万個のGPUとはどれほどの規模でしょうか?これはエネルギー省史上最大のAIスーパーコンピュータとなります。さらにEquinoxというシステムもあり、こちらはBlackwell GPUを1万個搭載し、2026年に稼働予定です。両システムを合わせると、2200エクサフロップスのAI計算性能を提供できます。

Argonne LaboratoryのディレクターであるPaul Kearnsは、これらのシステムがパフォーマンス、スケーラビリティ、科学的可能性を再定義すると述べました。これらの計算能力は、材料科学から気候モデリング、量子計算から核兵器シミュレーションまで、さまざまな分野で必要とされています。

政府研究所以外にも、NVIDIAはバージニア州にAIファクトリー研究センターを建設しました。このセンターの特徴は、単なるデータセンターではなく、実験場であることです。NVIDIAはここでOmniverse DSXというものをテストします。これはギガワット級AIファクトリーを建設するためのブループリントです。

一般的なデータセンターは数十メガワットの電力しか必要としませんが、ギガワットは中規模原子力発電所の発電量に相当します。

このOmniverse DSXブループリントの核心は、AIファクトリーを自己学習システムにすることです。AIエージェントが電力、冷却、ワークロードを継続的に監視し、効率向上のためにパラメータを自動調整します。たとえば電力網の負荷が高いときは、システムが自動的に消費電力を下げたり、蓄電池に切り替えたりできます。

このようなインテリジェントな管理は、ギガワット級の施設にとって極めて重要です。なぜなら、電気代や冷却コストが天文学的な数字になるからです。

このビジョンは非常に壮大で、黄仁勋は実現までに3年かかると述べました。AI-RANのテストは2026年に開始され、DRIVE AGX Hyperion 10を搭載した自動運転車は2027年に公道を走り始め、エネルギー省のスーパーコンピュータも2027年に稼働開始となります。

NVIDIAはCUDAという切り札を握り、AI計算の事実上の標準を掌握しています。トレーニングから推論、データセンターからエッジデバイス、自動運転から生物医学まで、NVIDIAのGPUはあらゆる場所で活躍しています。今回のGTCで発表されたこれらの投資と協力は、この地位をさらに強固なものにしました。