Delincuente utilizó un modelo de IA para robar datos de salud, información financiera y credenciales gubernamentales, y amenazó con exponer los datos a menos que se le pagaran más de $500,000.

Anthropic afirma que un ciberdelincuente ha utilizado su modelo de inteligencia artificial (IA) para robar información personal sensible y exigir cuantiosos rescates para no exponerla.

Miembros del equipo de inteligencia de amenazas de Anthropic, Alex Moix, Ken Lebedev y Jacob Klein, señalan en un nuevo informe que un ciberdelincuente hizo un uso indebido del chatbot Claude de la empresa de IA para ayudar en el robo de datos y en las demandas de rescate.

“Recientemente interrumpimos la actividad de un sofisticado ciberdelincuente que utilizó Claude Code para cometer robo y extorsión de datos personales a gran escala. El actor apuntó al menos a 17 organizaciones distintas…”

El actor utilizó IA en lo que creemos es un grado sin precedentes. Claude Code fue usado para automatizar el reconocimiento, recolectar credenciales de las víctimas y penetrar redes. Se permitió que Claude tomara decisiones tanto tácticas como estratégicas, como decidir qué datos exfiltrar y cómo redactar demandas de extorsión psicológicamente dirigidas. Claude analizó los datos financieros exfiltrados para determinar los montos de rescate apropiados y generó notas de rescate visualmente alarmantes que se mostraron en las computadoras de las víctimas.”

Anthropic afirma que el ciberdelincuente orquestó “una campaña de ataques sistemáticos que se centró en el robo integral de datos y la extorsión” utilizando el modelo de IA.

“El actor proporcionó a Claude Code sus TTPs operativos preferidos (Tácticas, Técnicas y Procedimientos) en su archivo CLAUDE.md, que se utiliza como guía para que Claude Code responda a los prompts de la manera preferida por el usuario…

El enfoque sistemático del actor resultó en la vulneración de registros personales, incluyendo datos de salud, información financiera, credenciales gubernamentales y otra información sensible, con demandas de rescate directas que en ocasiones superaron los $500,000.”

La empresa también señala que el uso de sus modelos de IA para fines ilícitos ocurre a pesar de sus esfuerzos por frenarlo.

“Hemos desarrollado medidas sofisticadas de seguridad y protección para prevenir el uso indebido de nuestros modelos de IA. Si bien estas medidas suelen ser efectivas, los ciberdelincuentes y otros actores maliciosos intentan continuamente encontrar formas de eludirlas.”

Imagen generada: Midjourney

Descargo de responsabilidad: El contenido de este artículo refleja únicamente la opinión del autor y no representa en modo alguno a la plataforma. Este artículo no se pretende servir de referencia para tomar decisiones de inversión.

También te puede gustar

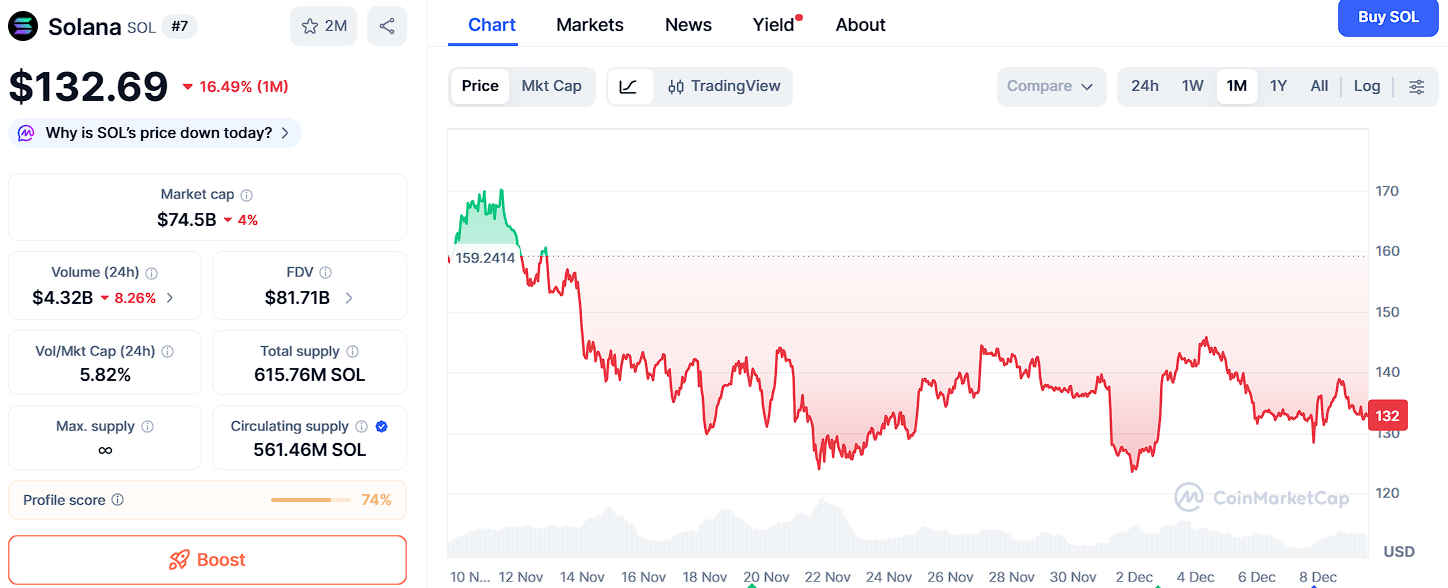

El impulso de Solana se dirige hacia los $800, pero la predicción de Ozak AI domina los modelos a largo plazo